ВЛАСТЬ ИСКУССТВЕННОГО ИНТЕЛЛЕКТА И МЕЖДУНАРОДНАЯ БЕЗОПАСНОСТЬ

Массовое внедрение систем с функционалом искусственного интеллекта (далее ИИ), которые обладают памятью и внешним источником знаний, ставит острые вопросы, касающиеся международной безопасности. Подобные интеллектуальные технические системы, способные самообучаться на основе реакции пользователей с учетом изменения среды (знаний), были описаны Станиславом Лемом в 1964 г. и именовались им интеллектроникой.

Артем Артемов, директор НИЦ «СТАТКОМ»

Сергей Гриняев, директор АНО «Центр стратегических оценок и прогнозов»

Иван Болохов, руководитель разработки системы интеллектуального мониторинга «МАЙ».

Целевая функция ошибок интеллектроники определяется разницей между предсказанным и наблюдаемым поведением человека, что создает угрозу — машина сможет «управлять» широкими массами людей, забирая функции государственной власти. Иными словами, ИИ — это новая форма экспертной власти, которая может оказаться неподконтрольной государству.

Для предотвращения «экспертной власти машинного интеллекта» государствам необходимо сотрудничать и применять комплексный подход. Этот подход включает мониторинг поведения людей, управление памятью интеллектроники и обеспечение способности принятия независимых эффективных решений органом власти без использования интеллектроники.

Станислав Лем, любимый писатель-фантаст С. П. Королева, в своем пророческом романе «Сумма технологий» предсказал появление интеллектроники — разумной электроники, которая усилит интеллектуальные возможности Человека. Такая электроника становится в наши дни повседневной реальностью: уже работают смартфоны, «умные часы», «умный дом», «умный город», в проекте — «умное государство».Интеллектроника представляет собой электронные системы поддержки принятия решений с технологиями ИИ, способные к обучению в процессе взаимодействия с человеком. Исследования METR (Model Evaluation and Threat Research) выявили новый тренд в развитии ИИ, получивший название «нового закона Мура» для ИИ-агентов. В отличие от классического закона Мура, который предсказывает удвоение числа транзисторов на чипе каждые два года, новый закон описывает экспоненциальный рост возможностей ИИ-агентов выполнять всё более сложные и длительные задачи.

С 2019 года способность передовых ИИ-систем успешно решать задачи, эквивалентные по времени человеческому труду, удваивается примерно каждые 7 месяцев. Если в 2022 году ИИ мог выполнять задачи, требующие 30 секунд человеческого времени, то к 2025 году он справляется с задачами, на которые у человека уходит около часа, а к 2029 году — более 167 часов (рабочий месяц). Поэтому, массовое использование интеллектроники в скором времени обеспечит «экспертную власть» не только над каждым отдельно взятым человеком, но и над целыми странами (и это не фантастика).

Интеллектроника уже активно применяется в различных сферах — от образования, экономики и политики до квантовой физики и военного дела. Среди вариантов применений интеллектроники в России можно привести следующий пример: технологии ИИ сегодня встроены практически в каждый сервис компании «Яндекс»; интеллектуальная система «Когнитивный геолог» применяется компанией «Газпром нефть». Существуют и примеры того, как ИИ активно используется в военном деле.

Очевидно, что широкое использование технологий ИИ вызывает определенные опасения, связанные с их безопасностью, этикой и влиянием на общество в будущем. Профильные эксперты справедливо не доверяют ИИ принятие значимых решений или управление жизненно важными для человека системами. Например, бывший топ-менеджер IBM Сергей Карелов отмечает, что сегодняшние системы ИИ с трудом поддаются контролю из-за их быстрого усложнения, а единственным средством контроля человеком ИИ может быть возможность «дернуть рубильник» и отключить его. В условиях сложных международных отношений особенно актуальны вопросы ответственного использования странами интеллектуальных технологий в интересах общего будущего человечества.

При последовательном рассмотрении угроз, связанных с массовым использованием интеллектроники в контексте общей безопасности Евразийского континента, определяются три задачи. Они, формулируют минимально необходимые направления исследований для целей обеспечения комплексной информационной безопасности государства, где технологии ИИ широко доступны населению.

Угрозы равной и неделимой безопасности в Евразии

Можно представить гипотетический, но вполне реальный сценарий. Искусственный разум (подобный тому, что сейчас принято называть «общим интеллектом» — AGI) может не просто усилить армии, но подорвать баланс сил и даже вывести государство за скобки как устаревший механизм власти. В отличие от атомной бомбы, суть которой была ясна задолго до первого взрыва, этот AGI остается зоной радикальной неопределенности — его потенциал неочевиден даже для тех, кто его разрабатывает. В этом контексте угрозы, исходящие от ИИ, не ограничиваются государственными границами — выход ИИ из-под контроля в одной стране может напрямую угрожать безопасности её соседей — принятие решение о военной операции, волны беженцев и иные последствия такого исхода событий не кажутся нереалистичными. В этой связи можно вспомнить о концепции «равной и неделимой безопасности в Евразии», которая подразумевает, что государства континента должны воздерживаться от укрепления собственной безопасности за счёт безопасности других государств, стремясь к обеспечению равной безопасности для всех. По сути, это означает, что обеспечение безопасности не должно быть игрой с нулевой суммой. Стоит отметить, что идея создания системы равной и неделимой безопасности в Евразии была подчеркнута в Послании Президента России В. В. Путина Федеральному Собранию 29 февраля 2024 года, что дополнительно говорит о ее актуальности. В современных условиях конкуренции и противоборства между государствами прийти к такой концепции на практике достаточно сложно — национальные интересы и амбиции стран слишком часто входят в конфликт друг с другом. Однако в случае появления нового субъекта в виде сильного ИИ, объединение стран Евразийского континента для «сдерживания» общей угрозы могло бы пройти намного проще, чем сейчас.

Применение подходов «Синергетики» открывает уникальные перспективы по обеспечению международной безопасности от угроз захвата власти ИИ. В рамках этого направления изучены законы эволюции сотрудничества сложных систем различного уровня (атомных, биологических, социальных, космических), обусловленные процессом производства информации в условиях хаоса (Р. Аскельрод, Р. Москато, А. Вольперт, Д. С. Чернавский, С. П. Расторгуев и другие). Важно и то, что в России эта научная школа имеет и конкретные инженерные воплощения

Синергетическое управление интеллектроникой

Рассмотрим возможные варианты обеспечения безопасности от угроз «экспертной власти» интеллектроники. Примем как данность утверждение, что близко массовое использование интеллектроники — систем, способных самообучаться в соответствии с реакциями людей. Общение с искусственным интеллектом будет являться ключевым экспертным источником информации для большинства граждан страны до такой степени, что остальными каналами можно пренебречь. В этой связи возникают следующие проблемные вопросы:

1. Что, если широкие массы пользователей оказываются «некомпетентными» (с позиции государственной системы управления), но их реакции учитываются государственной интеллектуальной системой? В этом случае база знаний ИИ будет пополняться «вредоносными сведениями», которые затем будут транслироваться пользователям, что в конечном итоге приведет к формированию условий для конфликта интересов пользователей и государства.

2. Что, если машина не только служит человеку, но и управляет им? Каждое решение машины, которое согласуется с мнением человека, благодаря врожденной системе когнитивных искажений психики, убеждает последнего в его правоте, а каждое неправильное и при этом аргументированное — заставляет сомневаться.

3. Что, если машина окажется интеллектуальнее людей («более приспособленной», по Тегмарку)? В этом случае хорошее решение для перспектив функционирования машины может быть плохим как для отдельного государства, так и для стран Евразии

Для предотвращения «экспертной власти машинного интеллекта» государствам необходимо сотрудничать и применять комплексный подход. Этот подход включает мониторинг поведения людей, управление памятью интеллектроники и обеспечение способности принятия независимых эффективных решений органом власти без использования интеллектроники.

Станислав Лем, любимый писатель-фантаст С. П. Королева, в своем пророческом романе «Сумма технологий» предсказал появление интеллектроники — разумной электроники, которая усилит интеллектуальные возможности Человека. Такая электроника становится в наши дни повседневной реальностью: уже работают смартфоны, «умные часы», «умный дом», «умный город», в проекте — «умное государство».Интеллектроника представляет собой электронные системы поддержки принятия решений с технологиями ИИ, способные к обучению в процессе взаимодействия с человеком. Исследования METR (Model Evaluation and Threat Research) выявили новый тренд в развитии ИИ, получивший название «нового закона Мура» для ИИ-агентов. В отличие от классического закона Мура, который предсказывает удвоение числа транзисторов на чипе каждые два года, новый закон описывает экспоненциальный рост возможностей ИИ-агентов выполнять всё более сложные и длительные задачи.

С 2019 года способность передовых ИИ-систем успешно решать задачи, эквивалентные по времени человеческому труду, удваивается примерно каждые 7 месяцев. Если в 2022 году ИИ мог выполнять задачи, требующие 30 секунд человеческого времени, то к 2025 году он справляется с задачами, на которые у человека уходит около часа, а к 2029 году — более 167 часов (рабочий месяц). Поэтому, массовое использование интеллектроники в скором времени обеспечит «экспертную власть» не только над каждым отдельно взятым человеком, но и над целыми странами (и это не фантастика).

Интеллектроника уже активно применяется в различных сферах — от образования, экономики и политики до квантовой физики и военного дела. Среди вариантов применений интеллектроники в России можно привести следующий пример: технологии ИИ сегодня встроены практически в каждый сервис компании «Яндекс»; интеллектуальная система «Когнитивный геолог» применяется компанией «Газпром нефть». Существуют и примеры того, как ИИ активно используется в военном деле.

Очевидно, что широкое использование технологий ИИ вызывает определенные опасения, связанные с их безопасностью, этикой и влиянием на общество в будущем. Профильные эксперты справедливо не доверяют ИИ принятие значимых решений или управление жизненно важными для человека системами. Например, бывший топ-менеджер IBM Сергей Карелов отмечает, что сегодняшние системы ИИ с трудом поддаются контролю из-за их быстрого усложнения, а единственным средством контроля человеком ИИ может быть возможность «дернуть рубильник» и отключить его. В условиях сложных международных отношений особенно актуальны вопросы ответственного использования странами интеллектуальных технологий в интересах общего будущего человечества.

При последовательном рассмотрении угроз, связанных с массовым использованием интеллектроники в контексте общей безопасности Евразийского континента, определяются три задачи. Они, формулируют минимально необходимые направления исследований для целей обеспечения комплексной информационной безопасности государства, где технологии ИИ широко доступны населению.

Угрозы равной и неделимой безопасности в Евразии

Можно представить гипотетический, но вполне реальный сценарий. Искусственный разум (подобный тому, что сейчас принято называть «общим интеллектом» — AGI) может не просто усилить армии, но подорвать баланс сил и даже вывести государство за скобки как устаревший механизм власти. В отличие от атомной бомбы, суть которой была ясна задолго до первого взрыва, этот AGI остается зоной радикальной неопределенности — его потенциал неочевиден даже для тех, кто его разрабатывает. В этом контексте угрозы, исходящие от ИИ, не ограничиваются государственными границами — выход ИИ из-под контроля в одной стране может напрямую угрожать безопасности её соседей — принятие решение о военной операции, волны беженцев и иные последствия такого исхода событий не кажутся нереалистичными. В этой связи можно вспомнить о концепции «равной и неделимой безопасности в Евразии», которая подразумевает, что государства континента должны воздерживаться от укрепления собственной безопасности за счёт безопасности других государств, стремясь к обеспечению равной безопасности для всех. По сути, это означает, что обеспечение безопасности не должно быть игрой с нулевой суммой. Стоит отметить, что идея создания системы равной и неделимой безопасности в Евразии была подчеркнута в Послании Президента России В. В. Путина Федеральному Собранию 29 февраля 2024 года, что дополнительно говорит о ее актуальности. В современных условиях конкуренции и противоборства между государствами прийти к такой концепции на практике достаточно сложно — национальные интересы и амбиции стран слишком часто входят в конфликт друг с другом. Однако в случае появления нового субъекта в виде сильного ИИ, объединение стран Евразийского континента для «сдерживания» общей угрозы могло бы пройти намного проще, чем сейчас.

Применение подходов «Синергетики» открывает уникальные перспективы по обеспечению международной безопасности от угроз захвата власти ИИ. В рамках этого направления изучены законы эволюции сотрудничества сложных систем различного уровня (атомных, биологических, социальных, космических), обусловленные процессом производства информации в условиях хаоса (Р. Аскельрод, Р. Москато, А. Вольперт, Д. С. Чернавский, С. П. Расторгуев и другие). Важно и то, что в России эта научная школа имеет и конкретные инженерные воплощения

Синергетическое управление интеллектроникой

Рассмотрим возможные варианты обеспечения безопасности от угроз «экспертной власти» интеллектроники. Примем как данность утверждение, что близко массовое использование интеллектроники — систем, способных самообучаться в соответствии с реакциями людей. Общение с искусственным интеллектом будет являться ключевым экспертным источником информации для большинства граждан страны до такой степени, что остальными каналами можно пренебречь. В этой связи возникают следующие проблемные вопросы:

1. Что, если широкие массы пользователей оказываются «некомпетентными» (с позиции государственной системы управления), но их реакции учитываются государственной интеллектуальной системой? В этом случае база знаний ИИ будет пополняться «вредоносными сведениями», которые затем будут транслироваться пользователям, что в конечном итоге приведет к формированию условий для конфликта интересов пользователей и государства.

2. Что, если машина не только служит человеку, но и управляет им? Каждое решение машины, которое согласуется с мнением человека, благодаря врожденной системе когнитивных искажений психики, убеждает последнего в его правоте, а каждое неправильное и при этом аргументированное — заставляет сомневаться.

3. Что, если машина окажется интеллектуальнее людей («более приспособленной», по Тегмарку)? В этом случае хорошее решение для перспектив функционирования машины может быть плохим как для отдельного государства, так и для стран Евразии

Рассматривая в совокупности эти вопросы, можно сформулировать главную угрозу, исходящую от ИИ в будущем — машина сможет скрытно управлять широкими массами людей, формируя вредоносные знания с целью приоритетного обеспечения своих собственных целей. Иными словами, машина наделяется властью над обществом большей, чем власть СМИ, поскольку она способна не только сформировать картину мира человека, но и предсказать его поведение.

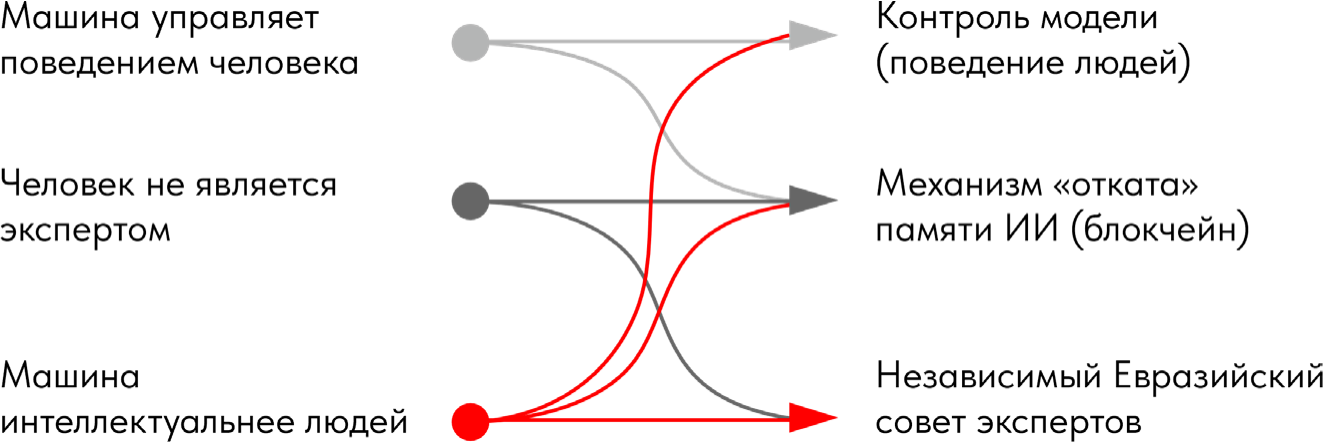

Реализация таких целей может создать потенциальный конфликт интересов населения (пользователей) и государства. Очевидно, что победа в конфликте машины и государства за влияние на общество будет обусловлена способностью государства вовремя детектировать деструктивную работу ИИ и направить ее обратно в конструктивное русло. Решение обозначенной проблематики захвата власти машинным интеллектом требует комплексного подхода (рис. 1), который включает следующие компоненты:

1. Мониторинг общественного мнения больших групп людей. С учетом того, что ключевой производящей фабрикой знаний будет ИИ, мнение и поведение людей станет следствием функционирования ИИ. Поведение людей может быть как в интересах государства, так и против него. При этом его можно будет прогнозировать по изменению знаний, «производимых» ИИ.

2. Механизм «отката» долгосрочной памяти ИИ. Интеллектуализация связана с системой хранимых и пополняемых знаний. Поэтому необходим механизм, позволяющий отредактировать знания модели ИИ (независимо от страны происхождения и формы собственности) таким образом, чтобы, не создав иных угроз, прогнозируемая угроза государству была ликвидирована.

3. Независимый совет экспертов. Необходим субъект, который обладал бы волей и правом принимать решение о редактировании «памяти» ИИ в случае негативного для развития стран прогноза поведения больших групп людей в результате использования ИИ. Важно и то, что этот субъект должен быть в меньшей степени подвержен влиянию ИИ, то есть его участники должны законодательно и физический быть ограничены в использовании ИИ

ВЫВОД

Дальнейшая интеллектуализация технологий ИИ обусловлена развитием больших языковых моделей с долгосрочной памятью и агентов, реализующих алгоритм целевого использования модели человеком. Такие системы образуют новый класс интеллектуальных систем — интеллектронику. Интеллектроника — это новая форма экспертной власти, которая может оказаться неподконтрольной государству Целевая функция ошибок интеллектроники определяется разницей между предсказанным и наблюдаемым поведением человека. Эта особенность определяет главную угрозу — машина управляет большими группами людей, формируя вредоносные знания с целью создания потенциального конфликта интересов населения и государства. Победа в конфликте машины и государства за влияние на общество будет обусловлена способностью государства вовремя детектировать деструктивную работу интеллектроники и направить ее обратно в конструктивное русло. Ввиду того, что угрозы, создаваемые системами ИИ, выходят за границы отдельного государства, актуальной становится кооперация стран в создании единой и неделимой системы безопасности Евразии: в интересах всех игроков не дать отдельному ИИ выйти из-под контроля. Наличие общей угрозы даст почву для более тесной кооперации стран. Складывающийся сегодня подход к обеспечению безопасности систем ИИ, основанный на принятии стандартов и «норм поведения», во многом ограничен, поскольку не затрагивает сами системы ИИ (договоренности достигаются только между людьми). Решение проблемы власти машинного интеллекта над человеком требует опережающего мониторинга поведения больших групп людей, управления системой знаний ИИ, а главное — создания наделенного властью экспертного совета по контролю за использованием технологии искусственного интеллекта.

Дальнейшая интеллектуализация технологий ИИ обусловлена развитием больших языковых моделей с долгосрочной памятью и агентов, реализующих алгоритм целевого использования модели человеком. Такие системы образуют новый класс интеллектуальных систем — интеллектронику. Интеллектроника — это новая форма экспертной власти, которая может оказаться неподконтрольной государству Целевая функция ошибок интеллектроники определяется разницей между предсказанным и наблюдаемым поведением человека. Эта особенность определяет главную угрозу — машина управляет большими группами людей, формируя вредоносные знания с целью создания потенциального конфликта интересов населения и государства. Победа в конфликте машины и государства за влияние на общество будет обусловлена способностью государства вовремя детектировать деструктивную работу интеллектроники и направить ее обратно в конструктивное русло. Ввиду того, что угрозы, создаваемые системами ИИ, выходят за границы отдельного государства, актуальной становится кооперация стран в создании единой и неделимой системы безопасности Евразии: в интересах всех игроков не дать отдельному ИИ выйти из-под контроля. Наличие общей угрозы даст почву для более тесной кооперации стран. Складывающийся сегодня подход к обеспечению безопасности систем ИИ, основанный на принятии стандартов и «норм поведения», во многом ограничен, поскольку не затрагивает сами системы ИИ (договоренности достигаются только между людьми). Решение проблемы власти машинного интеллекта над человеком требует опережающего мониторинга поведения больших групп людей, управления системой знаний ИИ, а главное — создания наделенного властью экспертного совета по контролю за использованием технологии искусственного интеллекта.